19 March 2026

GPT-5.4 Mini und Nano: Was Mittelständler jetzt über OpenAIs neue Modelle wissen müssen

Am 17. März 2026 hat OpenAI mit GPT-5.4 Mini und GPT-5.4 Nano zwei neue Modelle veröffentlicht, die speziell für schnelle, kosteneffiziente KI-Workloads gebaut sind. Beide Modelle sind über die OpenAI API und Azure OpenAI in Microsoft Foundry verfügbar. Für uns bei Aithoria war das ein lang erwartetes Update, denn seit dem Release von GPT-5.0 Mini im August 2025 gab es kein neues Mini-Modell mehr. In diesem Beitrag ordnen wir ein, was sich geändert hat, was es kostet und welche Modellstrategie jetzt für den Mittelstand sinnvoll ist.

Die lange Stille nach GPT-5.0 Mini

Als OpenAI im August 2025 GPT-5.0 Mini veröffentlicht hat, war das für uns bei aithoria ein kleiner Feiertag. Endlich ein Modell, das schnell genug für echte Produktiv-Workloads war, wenig genug kostete, um es auch bei hohem Volumen wirtschaftlich einzusetzen, und trotzdem gut genug "reasoned" hat, um nicht ständig Fehler zu produzieren.

Seitdem war GPT-5.0 Mini unser Arbeitstier, deployed über Azure OpenAI, eingebettet in die Microsoft-Infrastruktur unserer Kunden. Ob RAG-Lösungen auf Azure, Klassifizierungspipelines für Dokumente oder intelligente E-Mail-Routing-Systeme. ann immer ein Kunde eine Individualentwicklung brauchte, die nicht das absolute Maximum an Intelligenz erforderte, sondern zuverlässig, schnell und bezahlbar sein sollte, war 5.0 Mini die erste Wahl.

Dann kam GPT-5.1. Kein Mini.

GPT-5.2. Kein Mini.

GPT-5.3. Wieder kein Mini.

OpenAI hat über Monate hinweg die großen Flaggschiff-Modelle weiterentwickelt, aber die Modellklasse, die in der Praxis den Großteil der Arbeit erledigt, wurde nicht angefasst. Für uns als Beratungshaus, das Mittelständlern KI-Lösungen baut, war das frustrierend. Denn in der Realität setzt kaum ein Unternehmen das teuerste Modell für jeden einzelnen API-Call ein. Die Musik spielt bei den kleinen, schnellen Modellen.

Und wir waren nicht die einzigen, die das so gesehen haben. Wie Neowin treffend anmerkt [1]: Die monatelange Lücke hat es Wettbewerbern wie Google ermöglicht, das Segment mit Modellen wie Gemini 3 Flash zu besetzen. OpenAI hat hier eine Flanke offengelassen, und das in genau dem Marktsegment, das für produktive Anwendungen am relevantesten ist.

Vorgestern dann: GPT-5.4 Mini und GPT-5.4 Nano. Endlich.

Was ist neu und warum sollte dich das interessieren?

Lass uns nicht über Benchmark-Tabellen philosophieren, die am Ende doch nur KI-Nerds begeistern. Stattdessen die drei Dinge, die für dein Unternehmen wirklich relevant sind:

1. Doppelt so schnell bei besserem Ergebnis

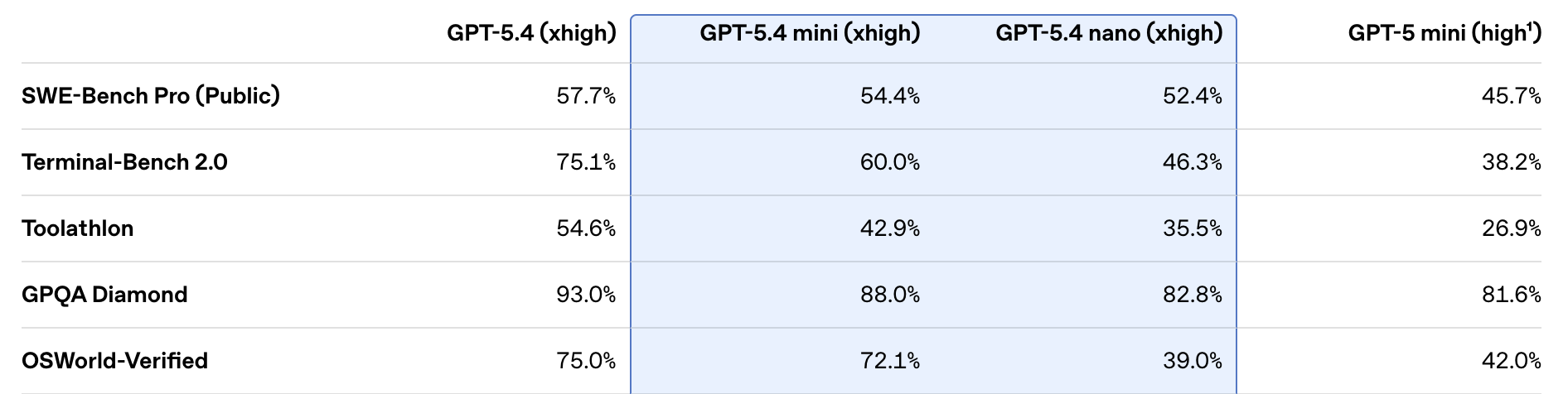

GPT-5.4 Mini läuft mehr als doppelt so schnell wie das alte 5.0 Mini [2]. In der Praxis bedeutet das: Dein Chatbot antwortet flüssiger. Dein Dokumenten-Klassifizierer schafft mehr Dokumente pro Minute. Deine Coding-Agents iterieren schneller. Und das nicht auf Kosten der Qualität. Ganz im Gegenteil. Im SWE-Bench Pro, einem anspruchsvollen Coding-Benchmark, erreicht 5.4 Mini 54,4 % gegenüber 45,7 % beim alten 5.0 Mini. Das große GPT-5.4 liegt bei 57,7 % [3]. Das Mini-Modell rückt also verdammt nah an das Flaggschiff heran.

Das bestätigt auch der erste Praxistest von TechRadar [4]: Bei alltäglichen Aufgaben wie Planung, Reasoning und Problemlösung seien die Mini- und Nano-Modelle oft kaum vom vollwertigen GPT-5.4 Thinking zu unterscheiden gewesen, nur eben spürbar schneller. Bei identischen Prompts kam der Tester im Wesentlichen zum selben Ergebnis, das große Modell brauchte nur deutlich länger dafür. Für den Alltag in der Unternehmens-KI eine wichtige Erkenntnis: Mehr Rechenzeit bedeutet nicht automatisch bessere Ergebnisse.

2. GPT-5.4 nano: das neue Einstiegsmodell für Routineaufgaben

Komplett neu in der 5.4-Reihe ist GPT-5.4 Nano. Ein Modell, das noch kleiner, noch schneller und noch billiger ist als Mini. OpenAI positioniert es explizit für Aufgaben wie Klassifizierung, Datenextraktion, Ranking und einfache Coding-Subtasks. Also genau die Art von Aufgaben, die in einer typischen Mittelstands-KI-Lösung 80 % des Volumens ausmachen.

Um die Kosteneffizienz greifbar zu machen: Developer-Blogger Simon Willison hat ausgerechnet, dass man mit GPT-5.4 Nano eine komplette Fotobibliothek von 76.000 Bildern für gerade mal 52 Dollar beschreiben lassen könnte [5]. Und: Nano unterbietet dabei sogar Googles Gemini 3.1 Flash-Lite. Also nicht nur günstiger als das alte OpenAI-Mini, sondern auch günstiger als die billigste Google-Alternative.

3. Das Subagent-Muster wird zum Standard, auch auf Azure

Mit Mini und Nano etabliert OpenAI ein Architekturmuster, das wir bei aithoria schon seit Monaten in Kundenprojekten auf Azure einsetzen: Ein leistungsstarkes Modell (GPT-5.4) übernimmt die komplexe Planung und Entscheidung, quasi als Senior Partner. Es delegiert dann Teilaufgaben an schnellere, günstigere Modelle (Mini oder Nano), die parallel arbeiten. Über Azure OpenAI lassen sich alle drei Modellvarianten im selben Tenant deployen. Ergänzend bietet Microsoft Foundry einen Model Router, der Anfragen automatisch nach Komplexität an das passende Modell weiterleitet.

Das ist kein theoretisches Konzept mehr. Es ist die Art, wie professionelle KI-Systeme ab jetzt gebaut werden. Dass GitHub Copilot GPT-5.4 Mini am selben Tag der Veröffentlichung direkt in die allgemeine Verfügbarkeit übernommen hat [6], ist ein starkes Signal: Der Markt nimmt dieses Modell sofort ernst. Und Notion berichtet, dass Mini in ihren internen Tests bei mehreren Aufgaben die Leistung des größeren GPT-5.4 erreicht oder sogar übertroffen hat, bei deutlich geringeren Kosten [2].

GPT-5.4 Mini vs. GPT-5.0 Mini: Die ehrliche Kostenfrage

Hier wird es interessant und hier lohnt sich ein genauer Blick. Denn auf den ersten Blick sieht die Preistabelle nicht nach Ersparnis aus:

GPT-5.4 Mini ist dreimal teurer beim Input und gut doppelt so teuer beim Output als das alte 5.0 Mini. Wer also einfach nur sein bestehendes 5.0-Mini-Setup auf 5.4 Mini umstellt, zahlt signifikant mehr.

Aber, und das ist der entscheidende Punkt, GPT-5.4 Nano ist sogar günstiger als das alte 5.0 Mini. Und zwar bei besserer Performance.

Die strategische Frage: Bleiben, wechseln oder splitten?

Genau hier wird es für Mittelständler spannend, die KI-Lösungen im Einsatz haben. Es gibt nicht die eine richtige Antwort, sondern drei sinnvolle Szenarien:

Szenario 1: Bleib auf GPT-5.0 Mini

Wenn deine bestehende Lösung stabil läuft, die Qualität ausreicht und du keine Lust hast, Prompts anzupassen und zu testen, dann ist „nichts ändern" eine valide Strategie. GPT-5.0 Mini verschwindet nicht über Nacht. Für rein kostengetriebene Setups, bei denen die Qualität heute schon gut genug ist, gibt es keinen Grund zur Hektik.

Unser Rat: Kurzfristig völlig okay. Mittelfristig wirst du aber feststellen, dass neuere Modelle bei gleichen Kosten bessere Ergebnisse liefern, und dass OpenAI irgendwann ältere Modelle abkündigt.

Szenario 2: Wechsel auf GPT-5.4 Nano

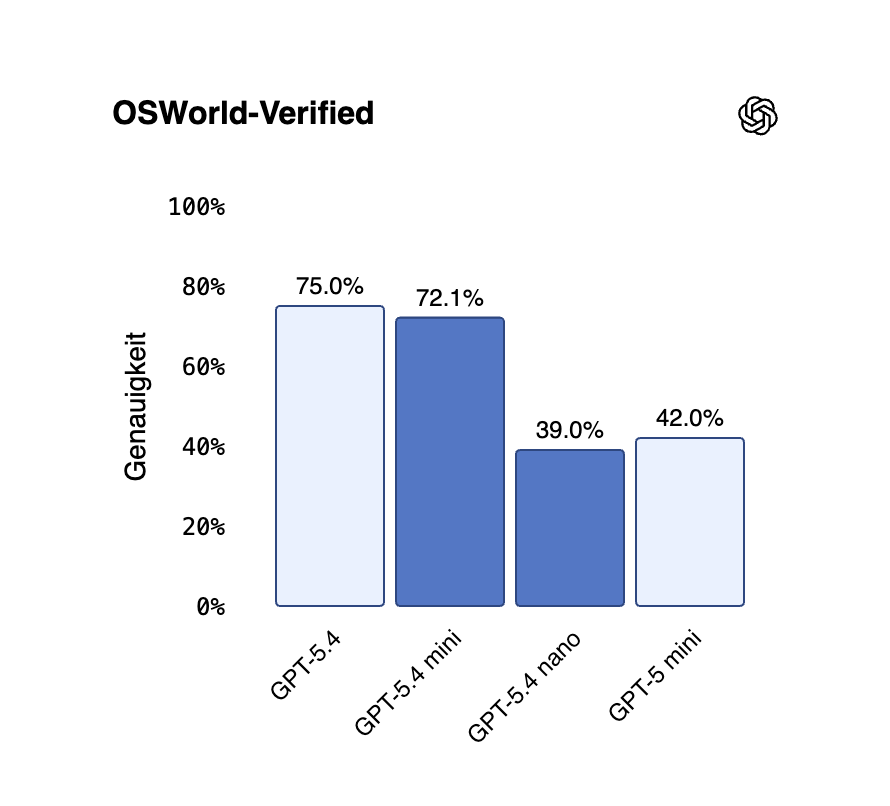

Für die meisten Routineaufgaben wie Klassifizierung, Extraktion, Routing, einfache Zusammenfassungen, ist GPT-5.4 Nano die logische Ablösung von 5.0 Mini. Günstiger, schneller, besser. Der einzige Nachteil: Bei komplexeren Aufgaben, insbesondere bei Computer Use und visuellen Desktop-Aufgaben, fällt Nano deutlich hinter Mini zurück.

Unser Rat: Wenn du heute 5.0 Mini für klar definierte, einfache Tasks einsetzt, ist der Wechsel auf Nano ein No-Brainer. Weniger Kosten, bessere Ergebnisse.

Szenario 3: Die Zwei-Modell-Architektur

Das ist der Ansatz, den wir bei aithoria für neue Projekte empfehlen, und der unserer Meinung nach die Zukunft ist. Du setzt GPT-5.4 Mini für alles ein, was Reasoning, Tool Use oder multimodale Verarbeitung erfordert. Und GPT-5.4 Nano für die vielen kleinen, repetitiven Aufgaben drumherum.

In der Praxis sieht das so aus: Ein Agent auf Basis von 5.4 Mini analysiert eine Kundenanfrage, entscheidet über die nächsten Schritte und formuliert die Antwort. Parallel extrahiert ein Nano-Subagent relevante Daten aus dem CRM, ein zweiter klassifiziert die Dringlichkeit und ein dritter prüft, ob ähnliche Anfragen in der Wissensdatenbank existieren.

Das Ergebnis: Schneller, günstiger und qualitativ besser als ein einzelnes großes Modell, das alles alleine macht.

Unser Rat: Für neue Projekte ist die Kombination aus Mini + Nano die wirtschaftlichste und zukunftssicherste Architektur.

Was heißt das konkret für den Mittelstand?

Die eigentliche Nachricht hinter diesem Release ist nicht, dass OpenAI zwei neue Modelle hat. Die Nachricht ist:

KI-Lösungen in Produktion werden gerade deutlich wirtschaftlicher.

GPT-5.4 Mini und Nano auf Azure OpenAI: Verfügbarkeit im DACH-Raum

Für Unternehmen, die ihre KI-Lösungen auf Microsoft Azure betreiben, und das betrifft die Mehrheit unserer Kunden, st ein Punkt besonders wichtig: GPT-5.4 Mini und Nano sind ab sofort in Microsoft Foundry verfügbar [7]. Microsoft Foundry (ehemals Azure AI Foundry) ist die zentrale Plattform, über die Azure-Kunden OpenAI-Modelle evaluieren, deployen und verwalten.

Konkret bedeutet das:

GPT-5.4 Mini und Nano lassen sich direkt im Model Catalog von Microsoft Foundry deployen, mit denselben Enterprise-Governance-Features wie alle Azure OpenAI Modelle: Richtlinien-Enforcement, Monitoring, Versionsverwaltung und Audit-Logging. Für GPT-5.4 und GPT-5.4 Pro ist aktuell noch eine Registration erforderlich [9]. Teams können über den integrierten Model Router Anfragen automatisch an das jeweils passende Modell weiterleiten, also z.B. komplexe Aufgaben an GPT-5.4, Standardaufgaben an Mini oder Nano. Laut Microsoft spart das bis zu 60 % der Inferenzkosten bei gleichwertiger Qualität. Die Modelle werden auch in der Data Zone EU ausgerollt, ein relevanter Punkt für DSGVO-sensible Deployments im DACH-Markt.

Wer heute bereits Azure OpenAI für GPT-5.0 Mini nutzt, kann die neuen Modelle also im selben Azure-Tenant deployen, ohne die Infrastruktur anzufassen. Das senkt die Migrationshürde erheblich.

Für mittelständische Unternehmen, die bisher vor den laufenden API-Kosten zurückgeschreckt sind, sinkt mit Nano die Einstiegshürde erheblich. Und für Unternehmen, die bereits KI-Lösungen im Einsatz haben, bietet die Zwei-Modell-Architektur die Möglichkeit, entweder bei gleichen Kosten bessere Ergebnisse zu erzielen, oder bei gleicher Qualität deutlich weniger zu zahlen.

Ein Gedanke, den man sich dabei bewusst machen sollte: In der Entwickler-Community kursiert gerade die Beobachtung, dass Frontier-KI die schnellste Wertminderung aller jemals gebauten Produkte hat [8]. Das Flaggschiff von heute wird in sechs Monaten zum kostenlosen Tier. Das klingt dramatisch, ist aber für Unternehmen eigentlich eine gute Nachricht, denn es bedeutet, dass die Kosten für gute KI-Ergebnisse kontinuierlich sinken.

Das ist nicht das Ende. Google hat mit Gemini 3.1 Flash-Lite ein vergleichbares Modell im Rennen, und Anthropic arbeitet an eigenen kosteneffizienten Varianten. Der Wettbewerb um das beste Preis-Leistungs-Verhältnis bei kleinen Modellen ist in vollem Gang und das ist gut für jeden, der KI in echten Geschäftsprozessen einsetzt.

Unsere Empfehlung

Wenn du eine bestehende KI-Lösung auf Azure OpenAI mit GPT-5.0 Mini betreibst, evaluiere jetzt GPT-5.4 Nano als Drop-in-Ersatz für deine Routine-Tasks. Das Deployment funktioniert im selben Azure-Tenant. Für komplexere Workflows, teste die Kombination aus Mini und Nano in einer Zwei-Modell-Architektur mit dem Model Router in Microsoft Foundry. Und wenn du gerade ein neues KI-Projekt planst: Starte direkt mit der Subagent-Architektur. Es ist der Weg, den die gesamte Branche geht.

Du willst wissen, was das konkret für deine bestehende Azure-OpenAI-Lösung bedeutet?

Sprich uns an: wir helfen dir, die richtige Modellstrategie für deinen Use Case zu finden.

Quellen:

[1] Neowin: OpenAI introduces GPT-5.4 mini and nano, its fast and efficient models for high-volume work — https://www.neowin.net/news/openai-introduces-gpt54-mini-and-nano-its-fast-and-efficient-models-for-high-volume-work/

[2] OpenAI: Introducing GPT-5.4 mini and nano, https://openai.com/index/introducing-gpt-5-4-mini-and-nano/

[3] ghacks.net: OpenAI startet GPT-5.4 mini und nano: Preise, Benchmarks, Codex und ChatGPT im Überblick, https://www.ghacks.net/de/2026/03/18/openai-gpt-5-4-mini-nano-start/

[4] TechRadar: I tested the new ChatGPT-5.4 mini and nano models — and I didn't expect them to be this powerful, https://www.techradar.com/ai-platforms-assistants/chatgpt/i-tested-the-new-chatgpt-5-4-mini-and-nano-models-and-i-didnt-expect-them-to-be-this-powerful

[5] Simon Willison: GPT-5.4 mini and GPT-5.4 nano, which can describe 76,000 photos for $52, https://simonwillison.net/2026/Mar/17/mini-and-nano/

[6] Build Fast with AI: GPT-5.4 Mini and Nano: Full Breakdown, Pricing, and Use Cases, https://www.buildfastwithai.com/blogs/gpt-5-4-mini-nano-explained

[7] Microsoft Tech Community: Introducing OpenAI's GPT-5.4 mini and GPT-5.4 nano for low-latency AI, https://techcommunity.microsoft.com/blog/azure-ai-foundry-blog/introducing-openai%E2%80%99s-gpt-5-4-mini-and-gpt-5-4-nano-for-low-latency-ai/4500569

[8] DataCamp: GPT-5.4 mini and nano: Benchmarks, Access, and Reactions, https://www.datacamp.com/blog/gpt-5-4-mini-nano

[9] Microsoft Learn: Foundry Models sold directly by Azure, https://learn.microsoft.com/en-us/azure/foundry/foundry-models/concepts/models-sold-directly-by-azure

.webp)